AI 不好用?99% 的人找错了原因

AI 系列课程第一季 ——《Easy Data x AI》完整课程内容传送门

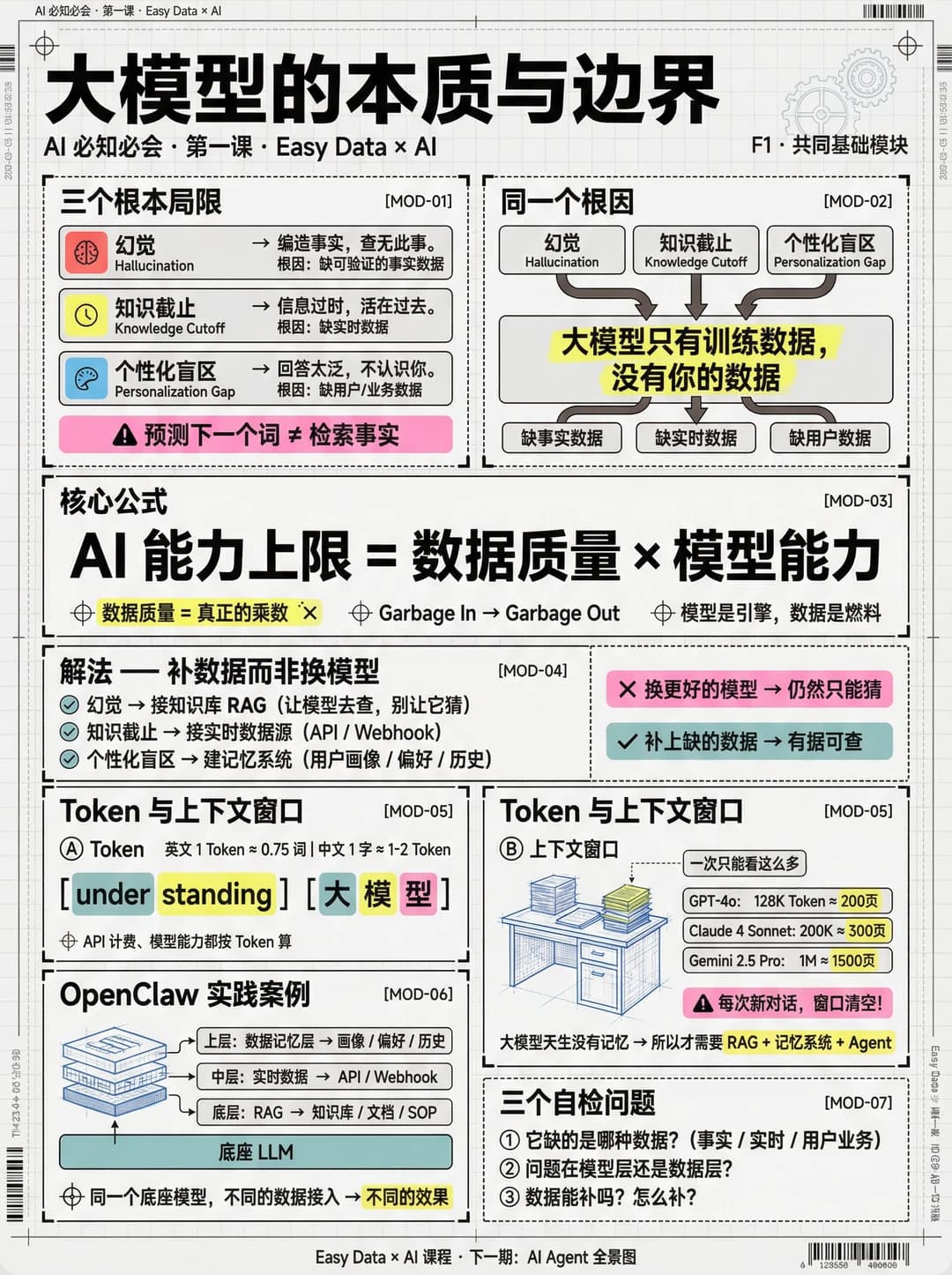

今天更新了 Easy Data x AI 课程的第一讲,大模型的本质与边界。欢迎大家点击上方链接,学习完整课程内容~

课程内容的大纲如下:

你有没有这样的经历![]()

问 AI 专业问题,回答得头头是道,结果一查——关键细节是编的。

问最近行业动态,它一脸茫然。

让它写方案,写得"正确"但太泛,不像你们团队的风格。

这不是模型的错![]() 是数据的错

是数据的错![]()

大模型有三个根本局限![]()

![]() 幻觉:听起来对,但查无此事(缺事实数据)

幻觉:听起来对,但查无此事(缺事实数据)

![]() 知识截止:它活在过去,不知道最新的事(缺实时数据)

知识截止:它活在过去,不知道最新的事(缺实时数据)

![]() 个性化盲区:回答正确但太泛,不认识你(缺用户/业务数据)

个性化盲区:回答正确但太泛,不认识你(缺用户/业务数据)

三个问题,同一个根因![]()

模型只有训练数据,没有你的数据。

![]() 核心公式:

核心公式:

AI 能力上限 = 数据质量 × 模型能力

怎么解?补数据,而非换模型![]()

![]() 幻觉 → 接知识库(RAG)

幻觉 → 接知识库(RAG)

![]() 知识截止 → 接实时数据源

知识截止 → 接实时数据源

![]() 个性化盲区 → 建记忆系统

个性化盲区 → 建记忆系统

还讲了 Token 和上下文窗口的概念![]()

大模型看世界的最小单位是 Token,不是"字"。

而且每次新对话开始,窗口就清空了——

所以大模型天生没有记忆![]()

正因如此才需要 RAG、记忆系统和 Agent 架构。

下次 AI 让你失望,先问自己三个问题![]()

① 它缺的是哪种数据?

② 问题在模型层还是数据层?

③ 数据能补吗?怎么补?

下一期我们会展开一张完整的地图——AI Agent 全景图,欢迎大家持续关注!