数据库管理-第410期 全网疯传的OpenClaw,总监用本地大模型跑通了! (20260314)

作者:胖头鱼的鱼缸(尹海文)

Oracle ACE Pro: Database

PostgreSQL ACE

10年数据库行业经验

拥有OCM 11g/12c/19c、MySQL 8.0 OCP、Exadata、CDP等认证

墨天轮MVP,ITPUB认证专家

圈内拥有“总监”称号,非著名社恐(社交恐怖分子)

公众号:胖头鱼的鱼缸

CSDN:胖头鱼的鱼缸(尹海文)

墨天轮:胖头鱼的鱼缸

ITPUB:yhw1809

IFClub:胖头鱼的鱼缸

除授权转载并标明出处外,均为“非法”抄袭

最近,小龙虾(OpenClaw)超级火,但是由于离职放松+春节+旅游,总监在最近一段时间没怎么碰电脑,本周回来了花了一点精力探索一下OpenClaw。

首先感叹一下,AI相关技术发展的迅速,从ChatGPT的横空出世,到RAG提升AI效能,然后是DeepSeek的强势出击,MCP对AI工具的增强,Skills完善开发流程,前面的技术发展一个比一个强,间隔一个比一个短。现在OpenClaw就是最新的“风口”。

首先说明一下,本文略长!

1 什么是OpenClaw

根据官网的介绍加上整合总结:

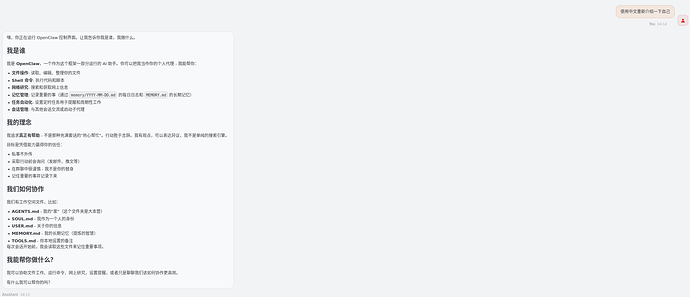

OpenClaw是一款轻量易用的自托管网关工具,核心功能是打通常用聊天应用与AI编程智能体的连接,让用户无需切换平台,即可通过熟悉的聊天工具随时调用AI编程助手,兼顾便捷性与数据安全性。

1.1 核心定位

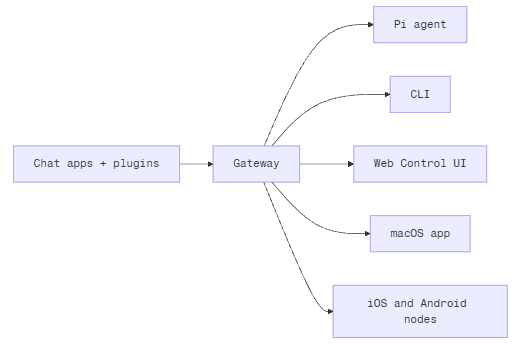

OpenClaw作为连接桥梁,可将WhatsApp、Telegram、Discord、iMessage等主流聊天应用,与Pi等AI编程智能体无缝对接。用户仅需在个人设备或服务器上运行一个网关进程,即可实现聊天应用与AI助手的全天候联动,无需依赖第三方托管服务,全程自主可控。

1.2 目标用户

主要面向开发者及高级用户群体,这类用户需要一款可随时随地通过消息调用的个人AI助手,同时注重数据隐私与控制权,拒绝将核心数据交付给第三方托管平台。

1.3核心优势

- 自托管特性:完全运行在用户自有硬件(个人设备或服务器)上,运行规则、数据管理均由用户自主决定,保障数据隐私与使用自主权。

- 多渠道兼容:一个网关进程可同时支持多个聊天平台,无需为不同应用单独部署,降低使用成本。

- 原生适配编程智能体:专为AI编程智能体设计,原生支持工具调用、会话管理、记忆留存及多智能体路由功能,适配编程场景的核心需求。

- 开源免费:采用MIT开源许可协议,由社区驱动迭代优化,用户可自由查看源码、二次开发,无商业使用限制。

1.4 部署要求

部署流程简单高效,仅需满足以下条件,5分钟即可完成部署:

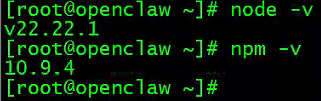

- 运行环境:推荐Node 24版本,或兼容的Node 22 LTS(22.16 及以上版本);

- 必备资源:所选AI服务提供商的API密钥;

- 优化建议:为保障使用体验与安全性,建议选用最新一代、性能最强的AI模型。

OpenClaw以“自主可控、多端兼容、轻量高效”为核心,为开发者提供了一种更灵活、更安全的AI编程助手调用方式,无需妥协数据控制权,即可享受全天候的AI辅助服务。

2 写在开始之前

本周刚刚回来,感觉有点“水土不服”,加上杂事比较多,其实是在不停的用零碎的时间在学习使用OpenClaw。上周在泰兰德的时候,其实也去关注了一下国际上关于OpenClaw的消息(那边看这些比较方便)。结合装了几次和小规模使用之后,总结出以下一些感受:

-

Token

使用OpenClaw调用各家大模型是需要消耗Token的,而Token是需要付费的,虽然Token的价格不断下降,但是在实际使用中也会看到常常是几十万的Token一个简单操作就没了,这也导致了很多场景还没开始“挣钱”就先欠了一屁股债。

从春节后国内各大大模型的“降速”来看,其实算力缺口依然是巨大的,尤其是硬件成本还在飞速上涨。在国外也是在各种方式疯狂的求电、扩建机房以增加算力。

AI本身的发展本身也是需要海量算力支持的,在当前的大环境下,大量基于个人需求的Token调用其实也会在一定程度上分走相当一部分算力。 -

安全

OpenClaw作为新兴的开源软件,还有许多来源不同外部的组件,注定会有许多漏洞和不成熟的地方,可能对个人信息安全和系统稳定带来挑战。

加上OpenClaw调用AI大模型,大模型受限于自身能力、幻觉以及过期信息等因素,也可能让OpenClaw做出错误的操作进而对你的电脑带来灾难性后果。 -

发展

在上周末看是看OpenClaw,其版本出现了2026.3.7,2026.3.8,2026.3.11,即便写本文当天(3月13日)天中午12点左右,OpenClaw又更新了2026.3.12,害的我又得从3.11升级到3.12。

快速发展带来功能扩展、稳定性增强、安全修复等升级固然是好的,但是在实际使用中也发现在不同版本中部分组件存在不兼容或需要调整的现象,而处理这些问题还是需要一定的技术能力的。 -

场景

从OpenClaw本身的介绍来看,它本身是一个面向个人的AI助手,但是在国内它似乎成为了一个无所不能的代名词,在很多地方深入工作生活的方方面面。但在国外大家对OpenClaw其实还是相对理性的,更多的是作为加速并简化工作与生活、学习了解并深入AI的媒介。

具体该如何看待OpenClaw发光发热的场景,我认为还需要等待OpenClaw或相关技术进一步的发展。

为了避免前面说到的一些问题,尽可能免费使用OpenClaw,因此我决定使用Ollama运行本地大模型,并在虚拟机运行OpenClaw调用大模型。

3 环境架构

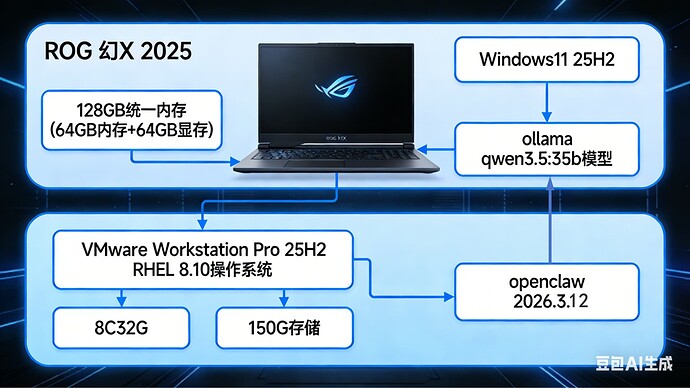

本次部署还是在我的幻X 2025(128GB)分别使用了Ollama运行LLM,OpenClaw在VMware WorkstationPro运行的虚拟机上进行部署,为了直观的展示部署架构,我分别使用豆包和DeepSeek生成了两张示意图。

豆包:

DeepSeek:

在这里也提前澄清一下,为什么没有使用更大规模模型(120b级别),主要原因是在32G内存+96G显存环境配置下,Ollama无论如何也无法正确调用显存。使用30b级别模型也使得可以配置更大内存的虚拟机运行OpenClaw。

4 OpenClaw部署

4.1 Ollama调整

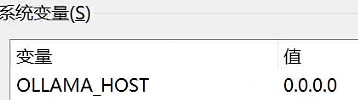

与《数据库管理-第390期 Ollama如何正常调用AMD GPU(20251114)》本机调用Ollama不同,虚拟机与宿主机得看作两台机器,因此在Windows中需要清理之前配置的OLLAMA_ORIGINS值为*环境变量,增加OLLAMA_HOST值为0.0.0.0的环境变量。

4.2 虚拟机配置

4.2.1 关闭防火墙与SELinux

systemctl stop firewalld.service

systemctl disable firewalld.service

sed -i 's/^SELINUX=enforcing$/SELINUX=disabled/' /etc/selinux/config

setenforce 0

#建议重启

4.2.2 配置yum源

mkdir /iso

#挂载镜像

mount -r /dev/sr0 /iso

rm -rf /etc/yum.repo.d/*

cat > /etc/yum.repos.d/iso.repo <<EOF

[AppStream]

name=AppStream

baseurl=file:///iso/AppStream

gpgcheck=0

enabled=1

[BaseOS]

name=BaseOS

baseurl=file:///iso/BaseOS

gpgcheck=0

enabled=1

EOF

4.2.3 dnf安装依赖软件

dnf -y install make cmake gcc-c++ git golang

4.2.4 安装node

export METHOD=script

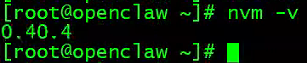

export NVM_SOURCE="https://gitee.com/mirrors/nvm/raw/v0.40.4/nvm.sh"

curl -o- https://gitee.com/mirrors/nvm/raw/v0.40.4/install.sh | bash

tee -a ~/.bashrc > /dev/null << 'EOF'

export NVM_NODEJS_ORG_MIRROR=https://npmmirror.com/mirrors/node

export NVM_NPM_MIRROR=https://npmmirror.com/mirrors/npm

EOF

nvm install 22

验证安装结果:

4.2.5 安装其他软件

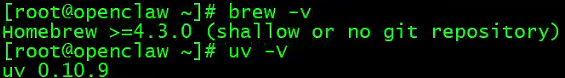

为了在后续使用OpenClaw安装其他组件,需要安装Homebrew和nv。

#1. 安装Homebrew

useradd linuxbrew

cat >> /etc/sudoers <<EOF

linuxbrew ALL=(ALL) NOPASSWD: ALL

EOF

su - linuxbrew

/bin/bash -c "$(curl -fsSL https://raw.githubusercontent.com/Homebrew/install/HEAD/install.sh)"

exit

cat >> /etc/profile <<EOF

export PATH=\$PATH:/home/linuxbrew/.linuxbrew/bin

EOF

#重连会话或执行

source /etc/profile

#2. 安装uv

curl -LsSf https://astral.sh/uv/install.sh | sh

验证安装:

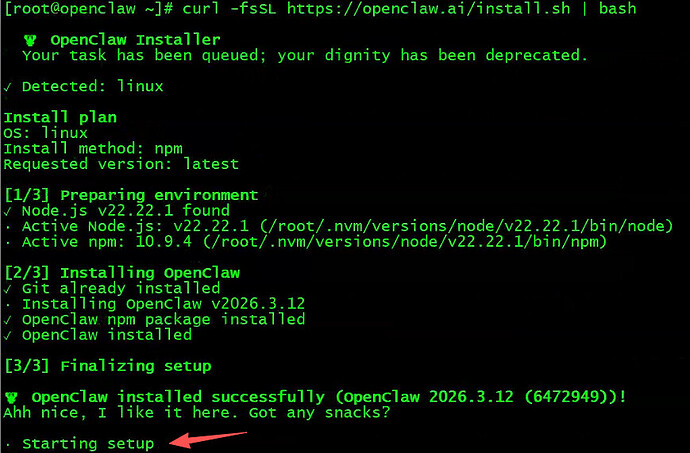

4.3 安装OpenClaw

使用官方推荐方式,安装最新版OpenClaw(2026.3.12)。

这里说明一下,脚本安装OpenClaw会自动安装对应的软件,但经常会出一些问题,所以前面提前安装完成需要的软件。

curl -fsSL https://openclaw.ai/install.sh | bash

安装完成后会自动进入配置操作,这里可以选择no或esc退出配置。(主要是为了给虚拟机打一个快照)

验证安装:

4.4 配置OpenClaw

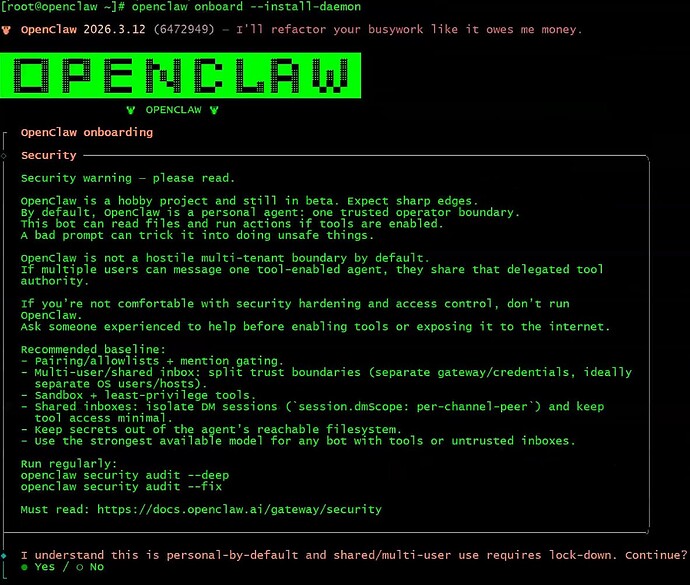

openclaw onboard --install-daemon

- 开始安装

在这里我们可以看到一些OpenClaw的安全警告。选择Yes回车进入下一步。

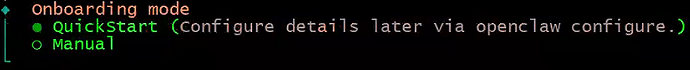

- 选择安装模式

选择快速开始(QuickStart)即可。回车进入下一步。

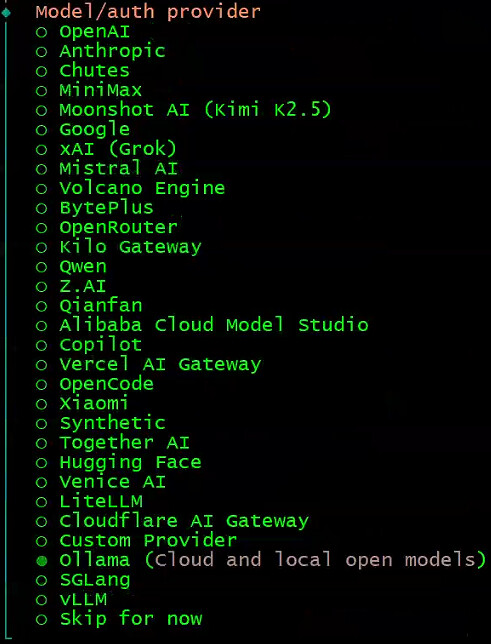

- 模型/授权提供商

选择Ollama。回车进入下一步。

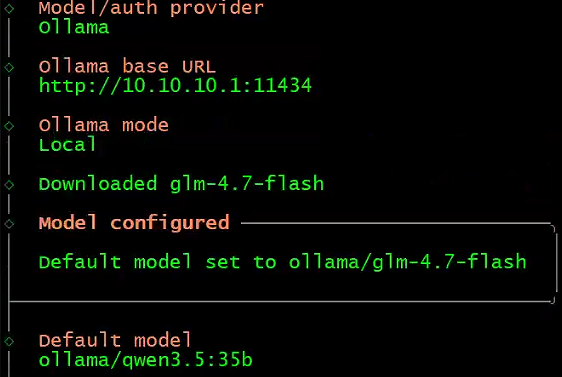

- Ollama配置

配置宿主机Ollama连接地址;

选择本地模型;

等待下载模型(这里OpenClaw会调用Ollama下载一个glm-4.7-flash模型);

选择qwen3.5:35b。回车进入下一步。

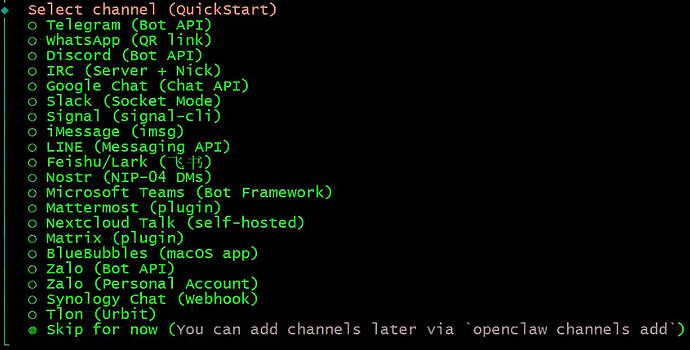

- 选择channel

选择暂时跳过(Skip for now)。回车进入下一步。

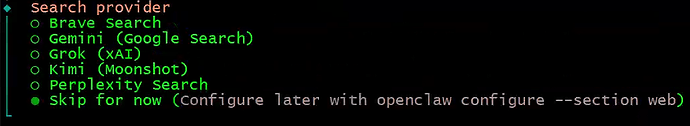

- 搜索提供商

选择暂时跳过(Skip for now)。回车进入下一步。

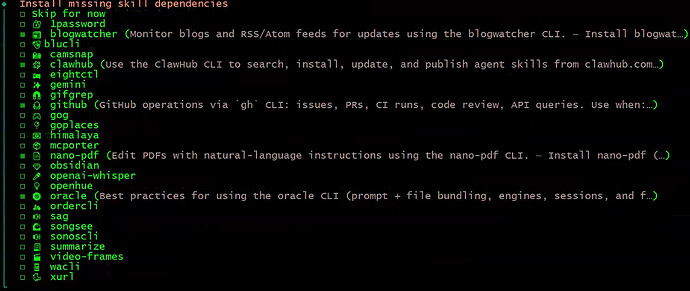

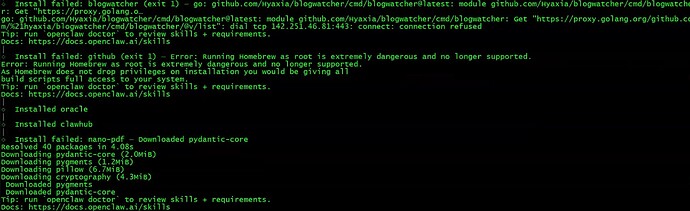

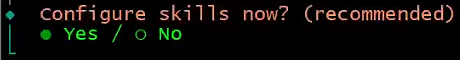

- 配置Skills

选择Yes回车进入下一步。

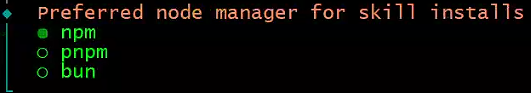

选择需要安装的skill依赖。空格选择后回车进入下一步。

选择安装方式。选择npm后回车进入下一步。

部分Skill安装有问题,后续再处理。

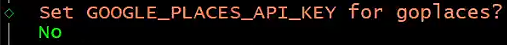

- 配置用于goplaces的GOOGLE_PLACES_API_KEY

选择no进入下一步。

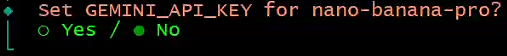

- 配置用于nano-banana-pro的GEMINI_API_KEY

选择no进入下一步。

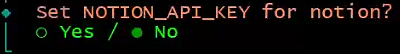

- 配置用于notion的NOTION_API_KEY

选择no进入下一步。

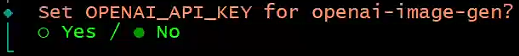

- 配置用于openai-image-gen的OPENAI_API_KEY

选择no进入下一步。

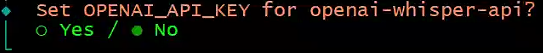

- 配置用于openai-whisper-api的OPENAI_API_KEY

选择no进入下一步。

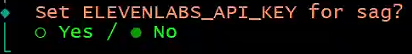

- 配置用于sag的ELEVENLABS_API_KEY

选择no进入下一步。

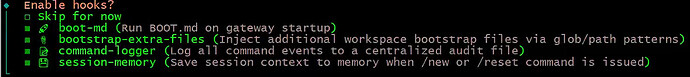

- 启用hook

空格选择所有,回车进入下一步。

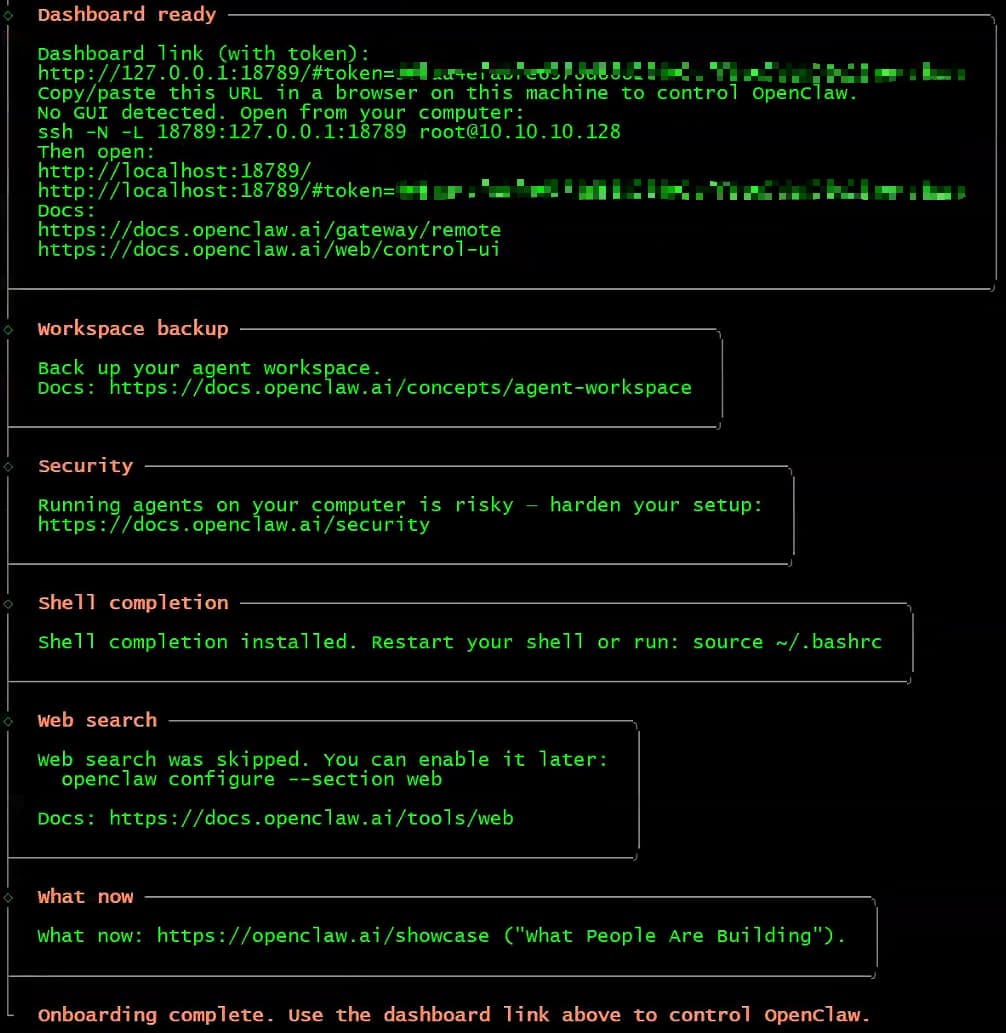

- 这一步完成后会安装Gateway

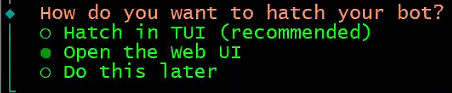

- 选择bot使用方式

选择Web UI方式。回车进入下一步。

- 安装完成

这里可以记录以下访问地址,端口和token。

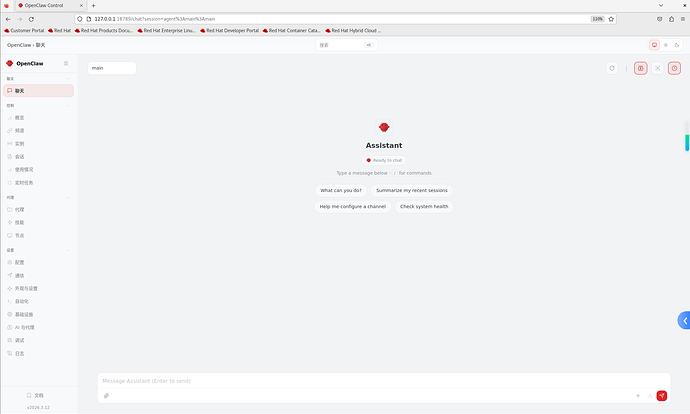

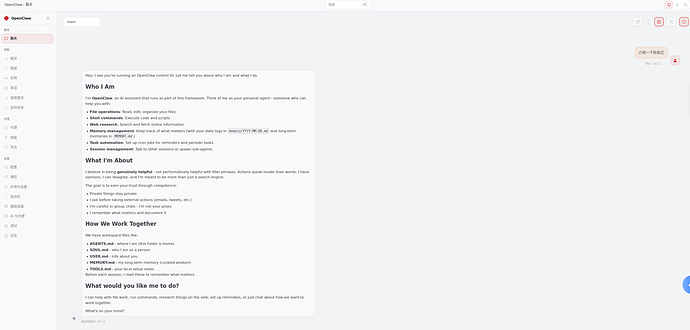

5 使用OpenClaw

打开网址:http://127.0.0.1:18789/#token=xxxx

使用Ollama qwen3.5:35b的速度还是很不错的,上面最后一个操作完成响应时间在12s左右。

总结

本期对OpenClaw进行了安装部署与简单使用,并添加了一些自己的感受,后续将继续探索更深入的内容并分享。

老规矩,知道写了些