尊敬的 OceanBase AI SIG 成员:

我们诚挚邀请您参加本周五 (2025.12.19) 的 AI 技术分享会,本次会议将聚焦于 AI 记忆管理领域的最新研究成果。我们特别精选了三篇 2025 年顶级会议论文,它们分别从不同角度探索了如何让 AI 系统更有效地记忆和利用历史信息,从而提升长期任务处理能力。期待与各位深入探讨!

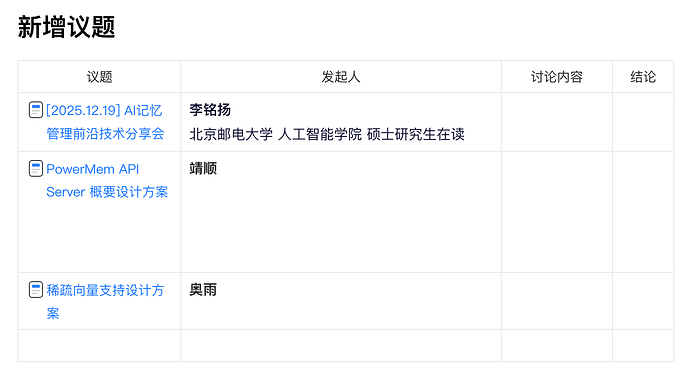

会议议程

主题:【社区】OceanBase AI SIG 周会

时间:12月19日 周五 15:00 - 16:00 (GMT +8:00)

会议号:581800573

入会链接:加入钉钉会议

可通过浏览器直接入会,无需下载钉钉。

分享嘉宾:

分享嘉宾:

李铭扬:北京邮电大学 人工智能学院 硕士研究生

目前北京邮电大学人工智能学院研究生在读,研究兴趣聚焦于智能体认知记忆、多智能体协作。

分享内容:

1. 论文分享

- Agent Workflow Memory(ICML 2025)

- In Prospect and Retrospect: Reflective Memory Management(ACL 2025)

- Lessons Learned: A Multi-Agent Framework for Code LLMs to Learn and Improve(NeurIPS 2025)

2. 自由交流与问题解答

论文亮点预览

论文亮点预览

-

Agent Workflow Memory (ICML 2025):

该研究提出了一种让 AI 智能体学习并复用任务工作流程的记忆机制。通过识别和存储可重复使用的任务步骤序列(工作流),显著提升了复杂任务的成功率,在 Mind2Web 和 WebArena 数据集上分别提高了 24.6% 和 51.1% 的相对成功率。此技术特别适用于需要多步骤交互的场景,如网页导航、自动化运维等,能有效减少重复推理,提升任务执行效率。 -

In Prospect and Retrospect: Reflective Memory Management (ACL 2025):

这篇论文引入了前瞻性和回顾性反思的双向记忆管理机制,解决了长期对话中记忆碎片化和检索僵化的问题。前瞻性反射动态组织对话记忆,回顾性反射则通过强化学习优化检索,使对话代理能够保持更连贯和个性化的交互。实验表明,在 LongMemEval 数据集上,该方法比无记忆管理的基线提高了 10% 以上的准确率。 -

Lessons Learned: A Multi-Agent Framework for Code LLMs to Learn and Improve (NeurIPS 2025):

该研究提出了一种多智能体框架,使代码 LLMs 能够通过协作学习和经验共享来持续优化自身性能。通过分层智能体架构和优先经验回放机制,实现了代码生成任务的记忆优化与自进化能力。此框架特别适合处理大规模代码生成和优化场景,每个智能体独立管理小规模代码记忆,但通过任务分解和层级组合形成全局记忆网络,支持动态扩展。

三篇论文的共同点在于:均关注动态环境下的记忆管理,通过优化记忆组织或检索提升模型性能,并结合强化学习或类似机制实现记忆的自适应更新。区别在于:AWM 专注于结构化工作流的记忆,RMM 注重非结构化对话记忆的动态组织,而 Lessons Learned 则探索分布式代码记忆的协作优化。

我们期待与各位共同探讨这些前沿技术如何与各自的业务场景结合,以及可能的改进方向。请提前 3 分钟进入会议,准备好您的思考和问题!

OceanBase AI SIG 团队

论文资料